O Déficit de Confiança: Por Que 46% dos Devs Não Confiam na IA (e Como SDD Resolve)

Sumário

- O Déficit de Confiança: Por Que 46% dos Devs Não Confiam na IA (e Como SDD Resolve)

- Anatomia do Déficit de Confiança

- Raiz 1: Falta de Rastreabilidade

- Raiz 2: Contexto Implícito (que a IA não tem)

- Raiz 3: Ausência de Verificação Automática

- SDD Como Antídoto Sistêmico

- Pilar 1: Contexto Explícito no AGENTS.md

- Convenções de Código

- TypeScript

- Dependências Bloqueadas (decisão de compliance, 2026-02)

- Padrões Arquiteturais

- Pilar 2: Especificações que Eliminam Ambiguidade

- Proposal: Autenticação por Email e Senha

- Context

- Requirements Explícitos

- Out of Scope (explicit)

- Acceptance Criteria

- Pilar 3: Verificação Automática como Linha de Base

- .speckit/verification.yml

- O Modelo de Confiança Incremental

- Nível 0: Confiança Zero (Ponto de Partida)

- Nível 1: Confiança Assistida

- Nível 2: Confiança Supervisionada

- Nível 3: Confiança Delegada (Freelance Agentic)

- A Inversão de Lógica

- Referências Técnicas

- Pesquisas e Dados

- Posts Relacionados

- Ferramentas

O Déficit de Confiança: Por Que 46% dos Devs Não Confiam na IA (e Como SDD Resolve)

Os números de 2026 são impressionantes: 84% dos desenvolvedores usam ferramentas de IA. Os modelos de ponta escrevem 41% de todo o código em produção. GPT-5.4 supera humanos em mais de 80% das comparações em benchmarks de trabalho real.

E, ainda assim, apenas 3% dos desenvolvedores confiam plenamente no output da IA.

Isso não é ironia. É um diagnóstico.

Não é um problema com a IA. É um problema com a ausência de estrutura em volta dela. Desenvolvedores que confiam na IA não têm acesso a modelos melhores — eles têm sistemas melhores para trabalhar com IA. E esse é exatamente o problema que o Spec-Driven Development foi construído para resolver.

Anatomia do Déficit de Confiança

Para resolver o problema, precisamos entender o que, especificamente, faz os desenvolvedores não confiarem. Não é "a IA erra" — todos sabemos disso. O déficit de confiança tem três raízes mais profundas:

Raiz 1: Falta de Rastreabilidade

"O código funciona, mas eu não sei por quê." Essa frase resume o primeiro problema. Quando a IA gera código sem referência explícita a uma especificação, o desenvolvedor não tem como auditar a decisão. Ele recebe um output sem contexto de intenção.

É como contratar um arquiteto que entrega a planta pronta, mas não mostra as normas técnicas que guiaram cada decisão estrutural. Você pode morar na casa. Mas quando algo quebrar, você está no escuro.

Raiz 2: Contexto Implícito (que a IA não tem)

A IA não tem acesso ao contexto não escrito do seu projeto. Ela não sabe que "a gente nunca usa any em TypeScript aqui". Ela não sabe que o time de compliance bloqueou o uso de determinada biblioteca no mês passado. Ela não sabe sobre a decisão arquitetural que aconteceu numa reunião que nunca foi documentada.

Então ela alucina. Não porque é burra — porque as restrições não estavam documentadas.

Raiz 3: Ausência de Verificação Automática

Quando um humano escreve código, ele roda os testes, faz o lint, verifica manualmente. Quando a IA gera código em volume, quem verifica? Em muitos setups de 2026, a resposta honesta é: "eu". O desenvolvedor. Linha por linha. O que não é sustentável e cria uma ansiedade constante sobre o que pode ter passado.

SDD Como Antídoto Sistêmico

O Spec-Driven Development não resolve cada alucinação individualmente. Ele cria um sistema que torna alucinações detectáveis e revertíveis — o que é funcionalmente melhor do que tentar eliminá-las.

Pilar 1: Contexto Explícito no AGENTS.md

O primeiro passo para confiar na IA é garantir que ela sabe o que você sabe. O AGENTS.md é o documento que converte conhecimento implícito da organização em instrução explícita para agentes.

Exemplos de restrições que costumam ficar na cabeça das pessoas (mas precisam ir pro AGENTS.md):

## Convenções de Código

### TypeScript

- NUNCA use `any`. Use `unknown` e faça narrowing explícito.

- Prefira `interface` sobre `type` para objetos que podem ser estendidos.

- Todos os arrays devem ter tipo explícito: `string[]` não `Array<string>`.

### Dependências Bloqueadas (decisão de compliance, 2026-02)

- lodash: use native JS. Motivação: bundle size + CVE-2024-12847

- moment.js: use date-fns. Motivação: tamanho e manutenibilidade

- axios: use fetch nativo. Motivação: padronização com edge runtimes

### Padrões Arquiteturais

- Repository Pattern para todo acesso a banco de dados

- Service Layer entre controllers e repositories — nunca acesso direto

- Eventos domínio > chamadas diretas para comunicação entre bounded contextsCada linha desse arquivo é uma alucinação a menos. E mais importante: é auditável — você pode ver exatamente o que a IA foi instruída a seguir.

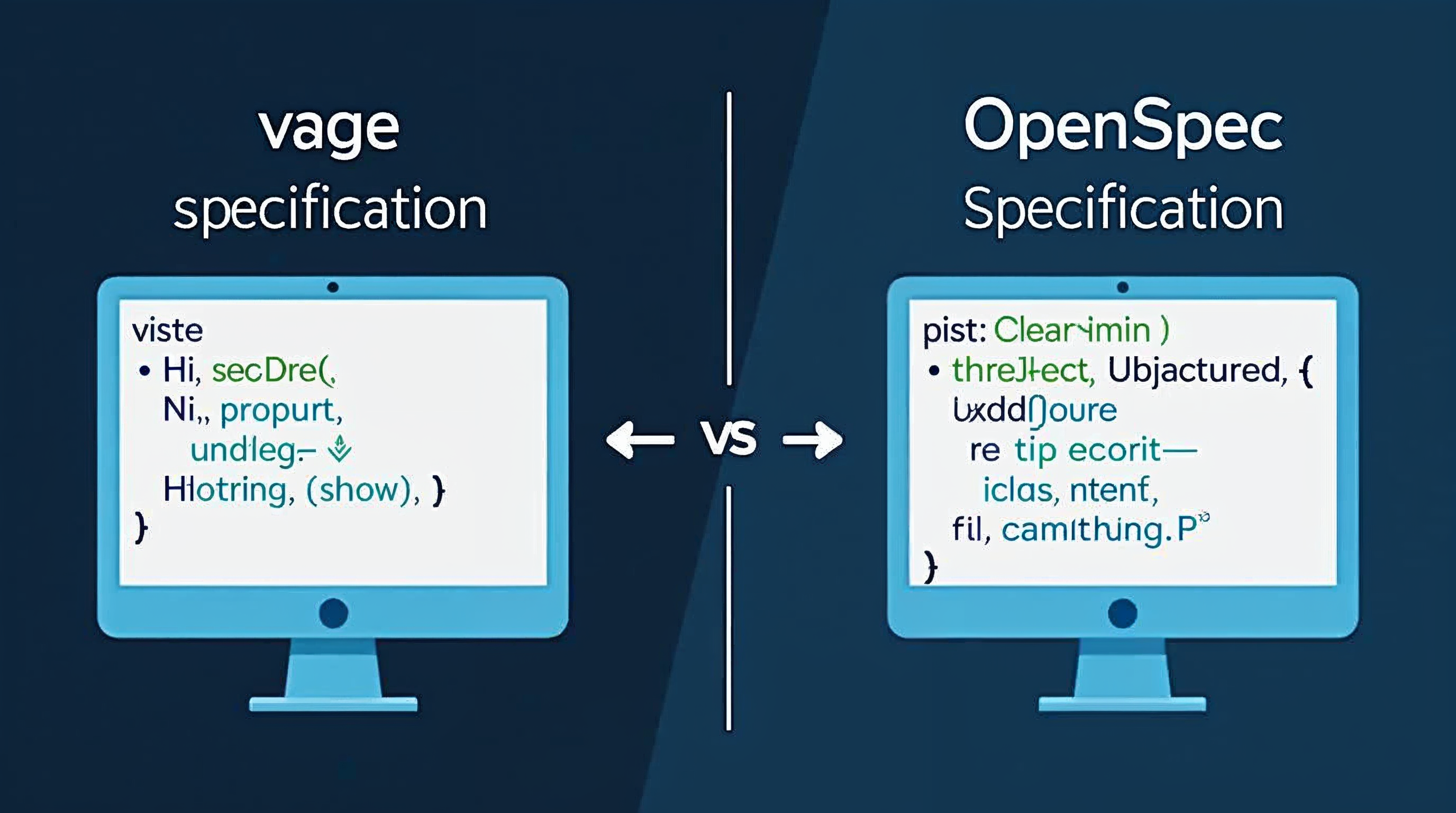

Pilar 2: Especificações que Eliminam Ambiguidade

O código gerado por IA é tão confiável quanto a especificação que o motivou. Uma especificação vaga gera código que pode estar "certo" em vinte interpretações diferentes — e você não sabe qual a IA escolheu.

Especificação ruim:

Criar sistema de autenticação com email e senhaEspecificação OpenSpec:

# Proposal: Autenticação por Email e Senha

## Context

- Sistema atual não tem autenticação

- Público: usuários finais (B2C), não desenvolvedores

- Compliance: LGPD — dados de sessão não podem ser armazenados em localStorage

## Requirements Explícitos

- bcrypt com cost factor 12 para hashing de senha

- JWT com expiração de 1h para access token

- Refresh token com expiração de 7 dias, rotação a cada uso

- Rate limiting: máximo 5 tentativas de login por IP por 15 minutos

- Nunca retornar mensagens específicas sobre email inexistente (prevenção de enumeration)

## Out of Scope (explicit)

- OAuth2/Social login (fase 2)

- MFA (fase 3)

- SSO enterprise (fase 4)

## Acceptance Criteria

- [ ] POST /auth/login retorna 200 com tokens ou 401 com mensagem genérica

- [ ] Token expirado retorna 401 com code EXPIRED, não INVALID

- [ ] Refresh token expirado invalida toda a sessão

- [ ] 100% de cobertura de testes nos cenários de rate limitingAgora compare: qual das duas especificações você confiaria para guiar um agente em produção?

Pilar 3: Verificação Automática como Linha de Base

A confiança não vem de "eu revisei linha por linha". Vem de saber que o sistema de verificação pegaria erros que eu perderia. O Spec-Kit implementa verificação automática em cada checkpoint:

# .speckit/verification.yml

on_task_complete:

- run: npm run lint

fail_on: errors

- run: npm run test:unit -- --coverage

fail_on: coverage_below_80

- run: npm run test:integration

fail_on: any_failure

- run: npx audit-ci --critical

fail_on: critical_vulnerabilities

- run: npx bundlesize

fail_on: size_regression_above_5pctQuando o agente completa uma task, esse pipeline roda automaticamente. Se qualquer verificação falha, o agente é bloqueado e você recebe um relatório antes de qualquer merge. Você não precisa ter fé no output — você tem evidência.

O Modelo de Confiança Incremental

A confiança em sistemas de IA não precisa ser binária — "confio totalmente" ou "não confio". SDD permite um modelo de confiança incremental baseado em evidência acumulada.

Nível 0: Confiança Zero (Ponto de Partida)

- Toda geração de código revisada manualmente

- Sem merge automático

- Todas as tarefas agenticas são pequenas e isoladas

Nível 1: Confiança Assistida

- Código gerado dentro de namespaces bem definidos pode ir direto para review automatizado

- Merge manual apenas após pipeline verde

- Tasks podem ter escopo médio (até 200 linhas de mudança)

Nível 2: Confiança Supervisionada

- Merge automático para mudanças de baixo impacto após pipeline completo

- Revisão humana obrigatória apenas para mudanças acima de threshold definido

- Agentes podem sugerir refatorações autônomas no escopo do seu domínio

Nível 3: Confiança Delegada (Freelance Agentic)

- O Regente valida apenas nos checkpoints estratégicos do Spec-Kit

- Mudanças de escopo definido executam e fazem deploy para staging automaticamente

- Deploy para produção permanece com aprovação humana (sempre)

A progressão entre níveis não é automática — ela é conquistada com evidência. Cada sprint sem incidentes gerados por agentes adiciona dados ao histórico de confiança. Cada alucinação capturada pelo sistema de verificação reforça a confiança na estrutura, não abala a confiança na IA.

A Inversão de Lógica

Existe uma crença comum de que você precisa confiar na IA para adotá-la. O SDD inverte essa lógica:

Você não precisa confiar na IA. Você precisa de um sistema confiável para trabalhar com ela.

Um cirurgião não confia que o bisturi nunca vai escorregar. Ele tem protocolos, checklists, assistentes e equipamentos que tornam o ambiente seguro apesar da possibilidade de erro. O SDD é esse protocolo para desenvolvimento agentico.

Os 46% que não confiam na IA não estão errados em desconfiar de outputs não estruturados. Eles estão errados em achar que a solução é confiar mais — quando a solução é estruturar melhor.

No próximo post, vamos falar sobre os novos modelos de março de 2026 e qual deles você deve usar como "cérebro" do seu sistema agentico — GPT-5.4, Claude Opus 4.6 ou Gemini 3.1 Pro.

Qual é o maior ponto de desconfiança no seu workflow com IA hoje? Uma alucinação específica que custou horas? Uma restrição que a IA ignorou? Conta abaixo — é exatamente esse tipo de caso que ajuda a refinar o AGENTS.md.

Referências Técnicas

Pesquisas e Dados

- AI Coding Assistant Statistics 2026: Adoption, Productivity, Trust — Dados completos sobre confiança e adoção

- AI Coding Productivity Statistics 2026: Gains, Tradeoffs, and Metrics — Análise de ganhos e trade-offs reais

- Top 15 AI Coding Assistant Tools to Try in 2026 — Panorama das ferramentas atuais

- METR: Measuring the Impact of AI on Experienced Developer Productivity — Estudo controlado sobre produtividade

Posts Relacionados

- Seu Projeto é um Sistema Operacional para Agentes — Fundação do AGENTS.md

- Documentação é o Novo Código — Context engineering como disciplina

- A Arte do Contexto: Masterclass R.T.C.C. — Técnicas avançadas de contexto

- AI Governance: Como Controlar os Agentes que Você Criou — Estrutura de controle

Ferramentas

- Spec-Kit: The Gated Workflow Engine — Pipeline de verificação automática

- sdd-skills-ai: Agentic IDE Boilerplate — Stack completo de verificação

- OpenSpec: Standardizing Agent Intent — Especificações que eliminam ambiguidade

Newsletter

Receba os melhores artigos toda semana

Sem spam. Só conteúdo de qualidade sobre IA & Dev.

Escrito por

eltonjose

Engenheiro de software e estrategista de produtos digitais, focado em IA pragmática e em transformar experiências de trabalho remoto em aprendizados aplicáveis. Compartilho frameworks e decisões reais que uso em consultorias e projetos.

- Principais temasSDD, AI Trust

- Formato do conteúdoGuia prático + insights de carreira